📢 横浜市、三重県、鳥取県にて Project Guideline 走行会を随時実施しています。詳しくは定期走行会のお知らせをご覧ください。

Project Guideline - 誰もが自由に、思うままに走れるために。

Project Guideline は、視覚障がいのある人が、Google AI の力で一人で自由に走ることを可能にすることを目指す Google の研究開発プロジェクトです。

“日本では、日常的に運動をしている人は約6割。

しかし、視覚障がい者の間では約3割にとどまっている。”

スポーツを楽しみ、スポーツに参加する機会を持つことは、すべての人に法律でも保障された権利です。しかし、様々な障がいのある人たちにとって、この権利は必ずしも現実となっていません。例えば自分一人で思うままに走るということさえ、視覚障がい者にとってはほぼ実現不可能な夢となってしまっています。

「視覚障がいのあるランナーが一人で走るために、

Google のテクノロジーを使ってできることはないだろうか?」

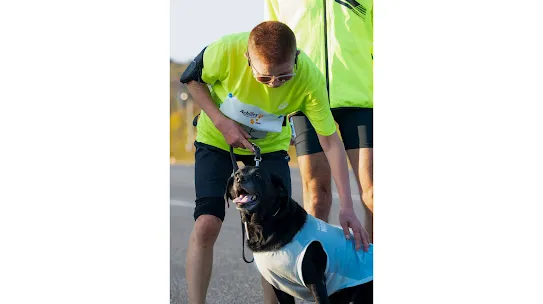

米国の NPO、Guiding Eyes for Blind の CEO であり、盲目のマラソンランナーでもあるThomas Panek さんからのこの問いかけに答えることが、私たちの出発点でした。すべての人が、自由に、自立して自分の可能性を追求できる。そんな社会を目指す小さな一歩として、この実験は始まりました。

誰もが使えるようになるためには、誰もがアクセスできる技術でなければなりません。どこにでもあるスマートフォンとヘッドフォンを使い、ランナーをガイドする技術を提供することを目指すこの研究開発プロジェクトは、Panek さんと協力して最初のプロトタイプを開発するとともに米国で 2020 年に発表されました。

パラスポーツ、そしてスポーツ全般への注目が高まった2021年、このプロジェクトを私たちは日本でも発表しました。視覚障がい者のための情報技術アドバイザーであり全盲のランナーでもある御園政光さんを最初のパートナーとして、さらにより多くの視覚障がいのある方たちに体験していただき、この技術をさらに向上させていく取り組みを始めています。

誰もが使えるようになるためには、誰もがアクセスできる技術でなければなりません。どこにでもあるスマートフォンとヘッドフォンを使い、ランナーをガイドする技術を提供することを目指すこの研究開発プロジェクトは、Panek さんと協力して最初のプロトタイプを開発するとともに米国で 2020 年に発表されました。

パラスポーツ、そしてスポーツ全般への注目が高まった2021年、このプロジェクトを私たちは日本でも発表しました。視覚障がい者のための情報技術アドバイザーであり全盲のランナーでもある御園政光さんを最初のパートナーとして、さらにより多くの視覚障がいのある方たちに体験していただき、この技術をさらに向上させていく取り組みを始めています。

Link to Youtube Video (visible only when JS is disabled)

すべての人が自分の可能性を追求できる社会へ

2022年には、障がい者と健常者が共にランやウォークを楽しむことを目指して活動するNPO法人アキレス・インターナショナル・ジャパンに技術提供。6人のチームでデジタルタスキを繋ぐバーチャル駅伝レース「ASICS World Ekiden 2022」に、視覚障がいのあるランナーだけで参戦するというチャレンジを支援しました。結果は、6人のランナー全員が Project Guideline の助けだけでタスキを繋ぎ、42.195kmを4時間29分44秒で完走。世界中から参加した健常者のチームとも互角に渡り合いました。

走ることには、一人で思うままに走るということに加えて、仲間と思いを繋いで走る、そして志を同じくするランナーたちと競いあうという楽しみ方もまたあります。そこに障がいの有無は関係ありません。世界中どこからでも参加できるバーチャルレースと Project Guideline というテクノロジーを組み合わせることは、視覚障がいのあるランナーが晴眼者のランナーと同じフィールドに立って、仲間とともに一つのレースに参加するという体験を追求するチャレンジでした。これは、Project Guideline が目指す、障がいの有無に関わらず、誰もが自由に自分の可能性を追求できる社会へ、という理念とも重なるものです。

走ることには、一人で思うままに走るということに加えて、仲間と思いを繋いで走る、そして志を同じくするランナーたちと競いあうという楽しみ方もまたあります。そこに障がいの有無は関係ありません。世界中どこからでも参加できるバーチャルレースと Project Guideline というテクノロジーを組み合わせることは、視覚障がいのあるランナーが晴眼者のランナーと同じフィールドに立って、仲間とともに一つのレースに参加するという体験を追求するチャレンジでした。これは、Project Guideline が目指す、障がいの有無に関わらず、誰もが自由に自分の可能性を追求できる社会へ、という理念とも重なるものです。

Link to Youtube Video (visible only when JS is disabled)

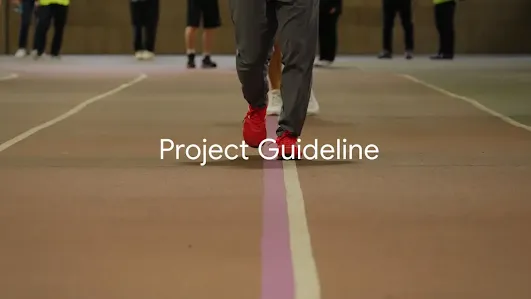

そして 2024 年、横浜市の障害者スポーツ文化センター横浜ラポールの協力のもと、Project Guideline は新たな一歩を踏み出しました。横浜ラポールの地下トラックに Project Guideline を導入し、視覚障がいのあるランナーの方が Project Guideline を体験できるプログラムを定期的に実施しています。それによって、より多くのランナーの方に「自由に、一人で走れる」 体験をしていただき、 Project Guideline をよりよい技術としていくためのご意見をいただける環境を整備しました。また横浜市からはじまった走行会は、現在は三重県、鳥取県へと広がっています。詳しくは定期走行会のお知らせをご覧ください。

Link to Youtube Video (visible only when JS is disabled)

Project Guideline の仕組み

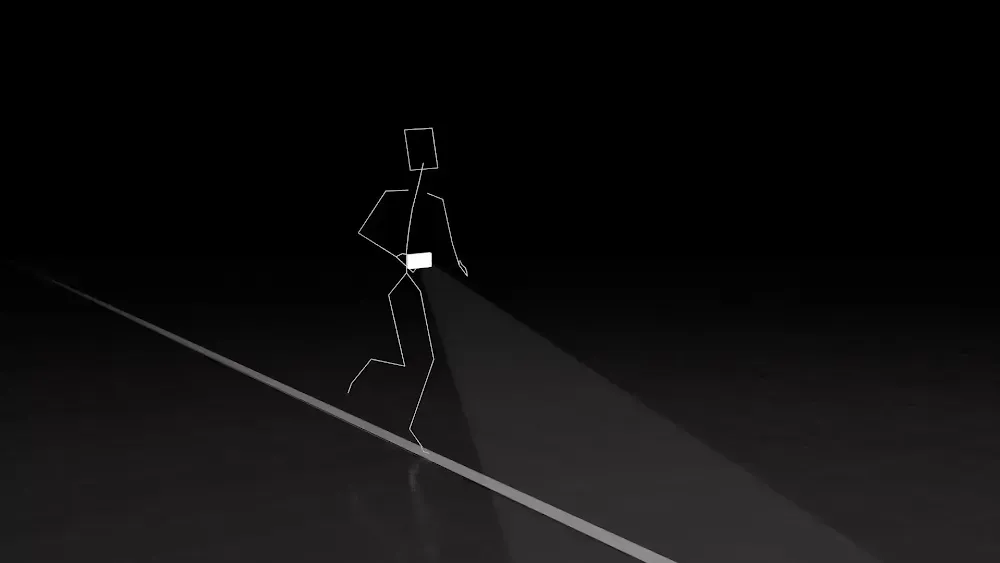

Project Guideline は、Android スマートフォン上で動作する機械学習技術を駆使した画像認識 AI を使用しています。地面に引かれた色のついた線を見分け、その線がランナーよりも左か、右か、中央なのかを瞬時に判断し、ヘッドフォンを通じて音声シグナルを送ります。ランナーはその音を頼りに、線から逸れることなくランニングを楽しめる仕組みです。

人間の目では道路に引かれた線を見分けることはとても容易ですが、それを機械で処理することは決して簡単ではありません。ランナーが装着したカメラは常に揺れていますし、外に出れば光の向きや明るさも常に変化します。コースには影や落ち葉が落ち、地面の色も一定ではありません。コースのカーブにも対応しなくてはなりません。

そうした様々な条件下でも正確な判断をできるよう、私たちは Google が公開する機械学習用オープンソースライブラリ TensorFlow™ を活用した画像認識 AI を構築し、可能な限り多様な状況で動画データを収集してモデルに学習させ、異なる環境でも精度とパフォーマンスを向上させてきました。また、Google が開発する拡張現実(AR)プラットフォーム ARCore などの技術を組み合わせることで空間認識能力をさらに向上させ、前方にあるカーブを事前に認識してランナーに通知したり、将来的には障害物の検知に対応させることなどにも取り組んでいます。

オープンソースによるコミュニティへの貢献

また、2023 年には、主にアクセシビリティの分野での技術革新に取り組む方々のコミュニティに貢献するため、Project Guideline をオープンソースとして公開しました。開発した基幹技術のソースコードや学習済みの画像認識モデル 、3Dシミュレータなどを無料で、誰もが利用できます。これにより、世界中の開発者や研究者が Project Guideline の技術を新たなアクセシビリティへの取り組みに活用したり、さらには全く新しい分野の技術開発に応用したりもできるようになりました。

世界がひろがる喜びを、すべての人へ。

見える人も、見えない人も。テクノロジーを使ってみんなで楽しむ「ノールック運動会」

スポーツに触れる機会がどうしても限られてしまいがちな視覚障がいのある子どもたちが、まずは体を動かす楽しさに触れ、ご家族など周囲の方々と一緒に気軽にスポーツを楽しむきっかけを作れないかという思いから、2024 年 11 月には「ノールック運動会」を開催しました。年齢・性別・運動神経に関わらず、だれもが楽しめる新スポーツを提案する一般社団法人世界ゆるスポーツ協会(通称:ゆるスポ)とコラボレーションし、 Project Guideline をはじめとした Google の研究プロジェクトやアクセシビリティ機能を活用した新スポーツの数々を考案。見える人も見えにくい人も見えない人も、運動が得意な人もそうでない人も、テクノロジーを使ってみんなで楽しめるスポーツイベントとなりました。そこには、テクノロジーを通じて、すべての人に世界がひろがる喜びを感じていただく一助となれれば、という願いがあります。

Link to Youtube Video (visible only when JS is disabled)

定期走行会のお知らせ

Project Guideline をより多くの皆様に体験していただくプログラムをパートナーの皆様のご協力により実施しています。詳しくはそれぞれの走行会プログラムページをご覧ください。

パートナーシップ

Project Guideline は、技術開発とユーザー体験の改良を重ねている開発中のプロジェクトです。当事者である視覚障がい者コミュニティの方々にデザイン・開発の過程に参加していただくことが最も大切だと考え、視覚障がいのあるランナーの方々に実際に Project Guideline をテストしてもらい、ユーザーにとってより安全で使いやすいシステムにしていくためのフィードバックをいただくことに取り組んでいます。そのため、下記のパートナーと協業し、データ収集やフィードバックのためのイベントやフィールドテストを行っています。

同様に Project Guideline を施設に導入し、視覚障がいのあるランナー向けの体験プログラムを提供する全国のパートナーを募集しています。関心のある自治体や団体の方はこちらのパートナー募集フォームからご連絡ください。